Quand l’Intelligence Artificielle redessine l’économie : Quelle est ma responsabilité ?

Cet article a été écrit par Guy TANTCHOU

Guy TANTCHOU

Expert en mécanique des structures et pionnier sur les applications de l’IA dans le packaging.

L'imprimerie a démocratisé le savoir. La machine à vapeur a déclenché la révolution industrielle. L'électricité a redéfini les modes de production et de vie quotidienne. L'automobile a remodelé les échanges commerciaux et l'urbanisme. Internet, enfin, a aboli les distances et connecté les marchés en temps réel. Chacune de ces inventions a bouleversé son époque, mais chacune restait limitée à un domaine ou à un usage principal. L'intelligence artificielle, elle, se distingue radicalement : elle n'est pas un outil spécialisé, mais une technologie qui cherche à optimiser notre manière d’interagir avec le monde qui nous entoure. De ce fait elle peut s'appliquer à tous les secteurs simultanément. Beaucoup la considèrent comme la plus grande invention humaine de tous les temps.

L'intelligence artificielle, elle, se distingue radicalement : elle n'est pas un outil spécialisé, mais une technologie qui cherche à optimiser notre manière d’interagir avec le monde qui nous entoure.

Et cette invention n'en est qu'à ses débuts. Aujourd'hui, l'IA s'infiltre dans toutes les sphères de l'économie à une vitesse remarquable. Elle optimise les chaînes logistiques, assiste les médecins dans leurs diagnostics, rédige des contenus, pilote des véhicules, gère des portefeuilles financiers et personnalise l'expérience de milliards de consommateurs. Les entreprises qui l'adoptent gagnent en productivité et en compétitivité ; celles qui l'ignorent risquent de disparaître. Ce déséquilibre rend tout retour en arrière économiquement impossible : les gains d'efficacité sont trop importants pour qu'un acteur rationnel y renonce volontairement. Mais cette intégration massive soulève aussi des dangers considérables. L'IA amplifie la capacité de produire de la désinformation et de la propagande à grande échelle. Elle creuse les inégalités entre ceux qui maîtrisent la technologie et ceux qui la subissent. Elle menace les libertés individuelles par la surveillance, le profilage et l'exploitation des données personnelles. À mesure que notre dépendance à ces systèmes grandit, une question philosophique s'impose avec force : sommes-nous encore libres de nos choix lorsque ceux-ci sont de plus en plus orientés, filtrés ou suggérés par des algorithmes ?

Les entreprises qui l'adoptent gagnent en productivité et en compétitivité ; celles qui l'ignorent risquent de disparaître.

Cette question est légitime, mais elle ne doit pas nous conduire à la résignation. Pour y répondre lucidement, il faut d'abord comprendre ce que l'IA est — et surtout ce qu'elle n'est pas. L'IA fonctionne selon une logique probabiliste : elle détecte des schémas dans les données, calcule des corrélations et optimise des résultats en fonction de critères mesurables. Autrement dit, elle excelle là où un problème est clairement défini et où la performance peut être quantifiée. Mais c'est précisément cette nature qui trace sa limite fondamentale : l'IA n'a pas de conscience. Elle ne ressent ni empathie, ni doute, ni sens moral. Par conséquent, elle est structurellement incapable de traiter les situations où la maximisation du profit ou la récompense statistique ne sont pas les principaux enjeux — la justice sociale, la dignité, l'éthique du soin, le lien entre les personnes. L'IA ne fait pas de magie : face à un problème mal posé, ambigu ou profondément humain, elle produira une réponse statistiquement plausible, mais pas nécessairement pertinente. C'est là que réside l'erreur la plus répandue aujourd'hui : se comparer à la machine ou attendre d'elle ce qu'elle est incapable de donner. Le défaitisme et la critique systématique naissent souvent de cette confusion. Or, si l'on accepte que l'IA a des limites intrinsèques, une conclusion s'impose d'elle-même : tout l'écosystème technologique et économique construit autour d'elle ne peut pas subsister sans l'équation humaine. Ce sont des personnes qui entraînent les modèles, corrigent leurs biais, encadrent leurs usages et les adaptent à des contextes culturels et sociaux variés. Le développement de l'IA aujourd'hui et demain continuera donc de dépendre directement des attentes que chaque individu, chaque entreprise et chaque société placera en elle — car ce sont ces attentes qui orientent les investissements, définissent les priorités de recherche et façonnent les produits qui en découlent.

L'IA fonctionne selon une logique probabiliste : elle détecte des schémas dans les données, calcule des corrélations et optimise des résultats en fonction de critères mesurables.

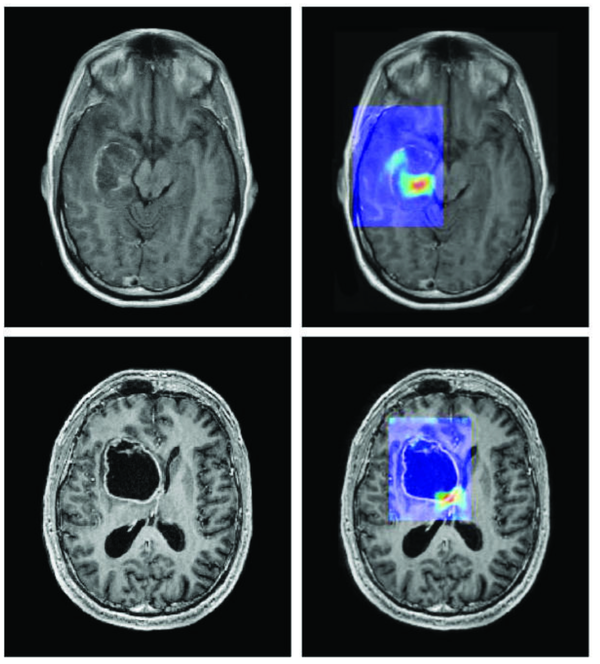

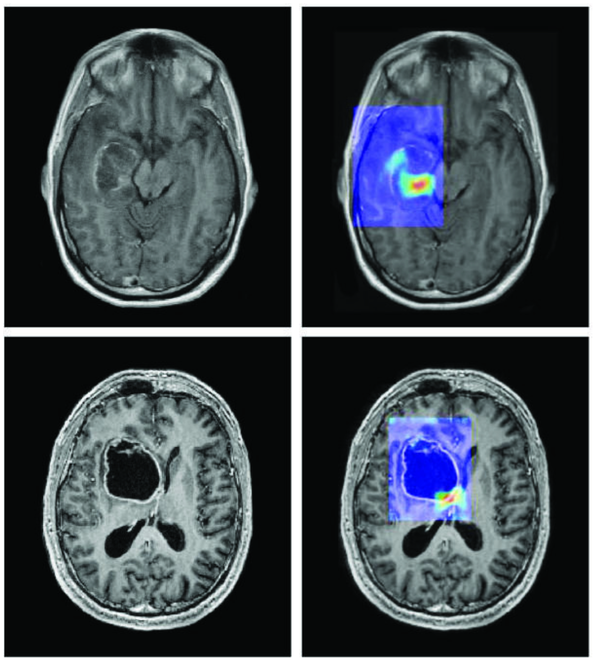

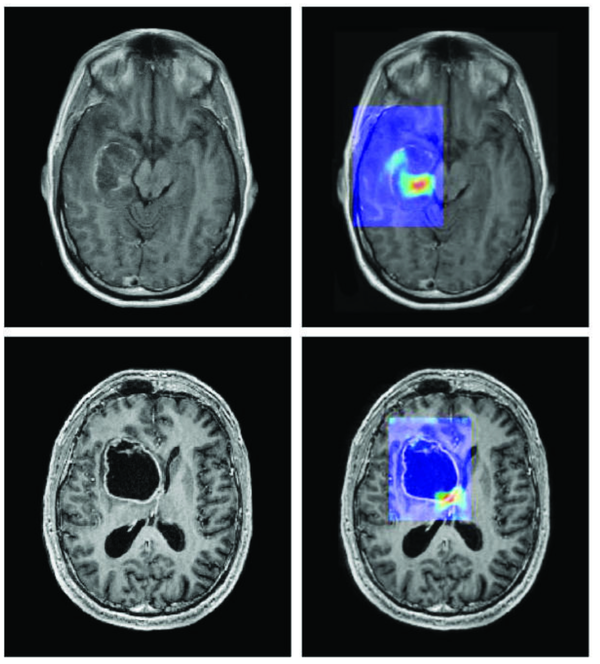

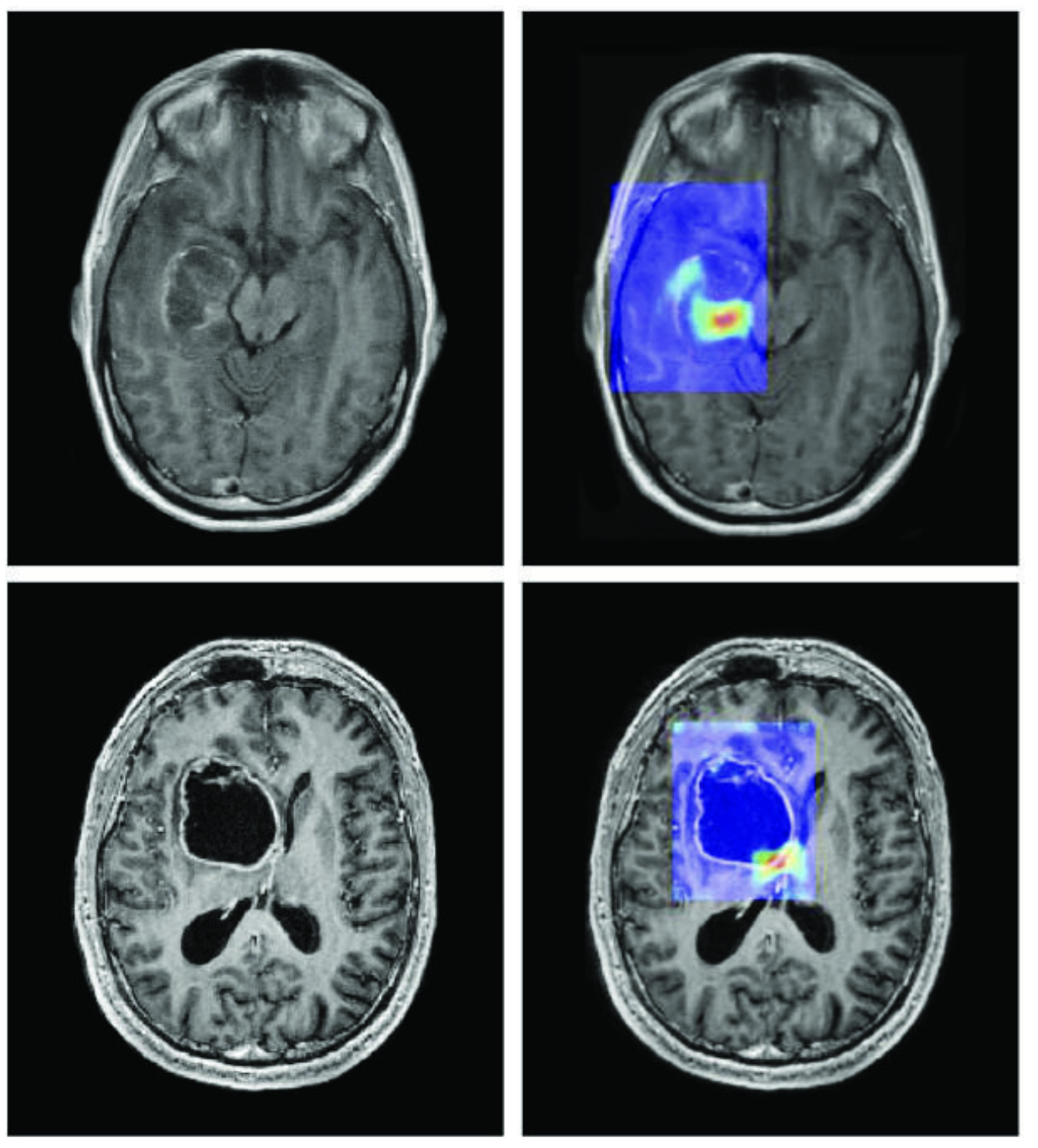

Trois situations concrètes illustrent déjà cette coexistence efficace entre l'humain et l'IA. En médecine, des systèmes d'IA analysent des milliers de radiographies en quelques secondes pour détecter des signes précoces de cancer [1], mais c'est le médecin qui interprète le contexte clinique du patient, engage le dialogue avec lui et décide du protocole de soin adapté : l'IA accélère le diagnostic, l'humain en porte la responsabilité et le sens. Dans l'industrie, des constructeurs automobiles utilisent l'IA pour piloter le contrôle qualité sur leurs lignes de production [2], identifiant des défauts invisibles à l'œil nu ; pourtant, ce sont les ingénieurs qui conçoivent les processus, ajustent les seuils de tolérance et prennent les décisions lorsqu'un problème sort du cadre prévu par l'algorithme. Enfin, dans la recherche scientifique, l'IA développée par DeepMind a permis de prédire la structure tridimensionnelle de plus de deux cents millions de protéines [3], un travail qui aurait pris des siècles aux chercheurs seuls ; mais ce sont bien des biologistes et des chimistes qui formulent les hypothèses, conçoivent les expériences et transforment ces prédictions en traitements ou en matériaux nouveaux. Dans chacun de ces cas, la leçon est la même : l'IA ne remplace pas l'humain, elle démultiplie sa capacité d'action.

L'IA ne remplace pas l'humain, elle démultiplie sa capacité d'action.

Que retenir de tout cela ?

L'IA est la plus puissante des inventions, mais aussi la plus exigeante envers ceux qui l'utilisent. Elle ne pense pas à notre place, elle ne devine pas nos besoins et elle ne corrigera pas d'elle-même les problèmes que nous ne savons pas formuler. Débattre pour ou contre l'IA, la craindre ou l'idolâtrer, c'est déjà se tromper de combat. Le vrai combat — celui de chacun d'entre nous — porte sur la manière de s'en servir pour résoudre des problèmes concrets : accélérer un diagnostic, améliorer un processus, faire avancer une recherche, prendre une décision plus éclairée. Cela suppose d'apprendre à poser les bonnes questions avant d'attendre les bonnes réponses, d'investir dans la formation plutôt que dans la fascination, et de garder en tête qu'un outil, aussi révolutionnaire soit-il, ne vaut que par l'intention de celui qui le manie. L'IA est un levier, pas une destination. C'est à chacun de nous de décider où il nous mène.

[1] Can Artificial Intelligence Help See Cancer in New, and Better, Ways?

[2] Artificial intelligence as a quality booster

[3] ‘The entire protein universe’: AI predicts shape of nearly every known protein